米ワイアード創刊編集長のケヴィン・ケリーさんが、新著『〈インターネット〉の次に来るもの―未来を決める12の法則』の発売に合わせて20日に来日。同日夜に、朝日新聞メディアラボ渋谷分室で、メディアアーティストの落合陽一さんと、「2050年 未来のメディア」をテーマとしたトークセッションを行った。

ケリーさんは、前著『テクニウム――テクノロジーはどこへ向かうのか?』の発売のタイミングで、2014年10月にも来日しており、その時も、デジタルテクノロジーのランドスケープについてお話を伺っている。

ケリーさんが『テクニウム』で提起したのは、46億年の地球の歴史の中で、テクノロジーがまるで自らの意思を持っているかのように"利己的進化"を繰り返してきたということ。

同書では、その仕組みと意味を明らかにし、テクノロジーの"不可避"な進化を理解して、それを受け入れることで、最大限のメリットを得ることができる、と説いた。

今回の『〈インターネット〉の次に来るもの』の原著のタイトルは『不可避(The Inevitable)』。そのメッセージは、『テクニウム』に重なる。

テクノロジーの"利己的進化"を、"12の避けられない法則"に分解し、それらが暮らしやビジネスの中でどんな意味を持つのか、どう対処していけばいいのかを分かりやすく読み解いている。

これらの"法則"は避けることはできないが、それはあくまでトレンドであって、現実の未来の"実装"は、自分たちで選び取るものだ。そのためにも、"法則"を理解しておく必要がある――それがケリーさんのメッセージだ。

ケリーさんは、人工知能(AI)、仮想現実(VR)、モノのインターネット(IoT)、ビッグデータ、と最先端の旬の話題を、過去から未来への風通しのいい見晴らしの中で整理する。

そのためか、先に昨年のうちに売り出された中国語版(タイトルは「必然」)の販売部数は、先行発売の当初2時間で2万部、そして今や60万部に到達したという。

今年6月発売の英語版もニューヨーク・タイムズのベストセラー、ビジネス部門で6位になっている。

さらに、日本のアマゾンでも、発売前から「ビジネスとIT」「インターネット・eビジネス」で1位を獲得するなど、話題を呼んでいた。

20日のトークイベントは、ペリスコープでも中継していたので、ご興味ある方はそちらもどうぞ。

以下は、当日の抄録です。

●ケヴィン・ケリーさんの基調講演

『不可避(The Inevitable)』というタイトルに、多くの人々は抵抗感を持ち、「不可避なことなどありえない」と考える人たちもいるでしょう。なるほど未来のテクノロジーを考える時、多くのものは"不可避"とは言えない。ただ、その一部のものは、予測したり、何が起きるのかということを見通すことが可能なのだ。

テクノロジーにはバイアス(偏り)がある。大きなシステムほど、何らかの方向に偏り、傾く傾向がある。こういったバイアスは、テクノロジーの性質そのものに由来する。テクノロジーを構成するワイヤ-や半導体チップ、スイッチ、それらの性質が組み合わさって、テクノロジーが特定の方向に向かうよう制約するのだ。これらの傾きが、長期的なトレンドを形作っていく。このトレンドは予測可能なものだ。だが、それが具体的にどのようなものになるのか、それについては予測することはできない。

雨が降って、谷から川に流れ込むことを考えてみると、水滴が具体的にどんな経路をたどるかは予測できないが、雨が低い方へ流れていく、という方向性なら予測できる。

例えば、4本足(の生物)というような一般的な形態については予測できるし、"不可避"と言えるが、シマウマやウマといった特定の種については、予測は不可能だ。電気が使えるようになれば電話は不可避だが、アイフォーンはそうではない。電話が使えるようになればインターネットは不可避だが、ツイッターはそうではない。

私はデジタルテクノロジーを見渡して、それが向かっていく12の異なる傾斜、方向性を導き出し、それを新著の12の章立てにした。今晩は、そのうちの2つについてお話したい。

その1つはインタラクション(相互作用)。その代表的なものがヴァーチャルリアリティ(仮想現実、VR)だ。

ここ(プレゼンの画像)に(ヘッドマウントディスプレーをつけて)写っているのは1989年の私。まだ(初のVRカンファレンス)"サイバーソン"の開催前。となりの画像はジャーロン・ラニア。ヴァーチャルリアリティという言葉をつくった人物です。これは彼がつくったゴーグルとグローブだが、1989年当時としても、かなり優れたVRだった。

VRは5年で普及するだろうと思ったが、大きな間違いだった。間違った原因は、このほかにトラッキング機能も含めた装置に必要な費用が、現在の価格で100万ドル(1億円)もかかったからだ。だが今になって、これだけVRのことが話題になり、非常に普及してきている理由は、スマートフォンだ。スマートフォンのテクノロジーは、極めて安価だからだ。

このテクノロジーは3つの要素技術を含んでいる。頭部のトラッキングのためのジャイロスコープ、加速度センサー、ゴーグルに搭載するスクリーン、そしてデータ処理のためのチップ、それらが十分に小型化された。これらがVRを、さほど高度化したとは言わないが、ずっと安価なものにした。3ケタ分ぐらいコストが減った。それによって、いまのようなVRの普及をもたらした。

VRには2種類ある。(没入型の)VRは、ゴーグルを装着することで、別世界に転送され、別の場所にいるような感覚になる。もう一つは(実在感の)ミックストリアリティ(複合現実、MR)。こちらは、透明なメガネを通して、実際の部屋の中に人工物、人工的な人々を見ることができる。MRの最もすぐれた事例は、マジックリープのような会社だ。機能もすぐれていて、本当にそこに何かがいるような感覚になるし、手でそれを動かすこともできる。かなりいい出来上がりだ。

2種類のうち、MRの方が実装は難しい。MRができさえすれば、VRはずっと簡単に実現できる。その過程にあるのが、「ポケモンGO」だ。ゴーグルではなく、スマートフォンのフラットなディスプレー使うことで、ヴァーチャルな存在感がどういったものか、ということを教えてくれる。

MRでできることとしては、製品のデザインや、教育目的で、図表を動かしながら教えるという使い方もできる。オフィスに、好きなだけ大きなサイズの仮想のスクリーンを置き、しっかりとその内容を読むこともできる。

VRはさらに2つの種類に分けられる。1つは、安価でシンプルなものだ。周囲を見渡したり、上下を見たりする。VR映画なら、上下左右の回転(スイベル)で見渡すことがができる。それ(ゴーグル)は安価な段ボールで可能だ。2つ目は、部屋中にセンサーをつけ、その中を自由に歩き回る(ローム)タイプ。こちらの方が、様々な角度から対象物を調べることができ、より没入できるが、より複雑で、コストも高くつく。

わかってきたのは、実在感を感知するのは、50%以上が視覚以外の、聴覚や手の触覚が関わっているということだ。

(プレゼン画像は)マイクロソフトのテレプレゼンスのデモです。私もプロトタイプを試してみたが、非常に説得力のあるものだった。実物大の人物がおり、髪の毛の1本1本、肌、布の繊維まで、その実在感は極めてリアルで、それを体感できるのだ。

VRのパワーを示す一般的なトリックがある。あなたは室内に立っているが、VRの中では床を取り払われ、崖の淵にいるという映像を映し出す。見下ろすと何百メートルの奈落。あなたの頭の中では、自分が室内にいることがわかっているが、あなたの体は、「死の危険にさらされている、後ずさりしなければだめだ」と告げる。なぜならVRで起きていることは(視覚をつかさどる)後頭葉に働きかけており、(認知機能をつかさどる)前頭葉ではないからだ。

VRから得られるのは、知識や情報のインターネットから、経験のインターネットへの移行だ。知るのではなく、感じ、経験するのだ。それは多くの点ではるかに強力なものだ。経験は、このデジタルワールドにおける新たな通貨だ。経験をダウンロードすることも、経験を交換することも、経験を共有することもできる。それらは新たな知識、新たなデータになる。

スリルを味わうということだけでなく、誰かに隣にいてもらう、新しいもののデモを見る、などありとあらゆるタイプの経験を、VRを通して伝えることになり、VRが経験の新たなプラットフォームになっていく。

最も重要な経験は、VRの中にいる他の人々との経験だ。今のところ、VRでもっとも興味深いのは、モノや世界ではなく、そこにいる人々だ。VRは、ソーシャルメディアの中でも、最もソーシャルなものになるだろう。VRこそ、ソーシャルメディアの中での交流の場として、最も重要なものになっていくだろう。

インターネットでは、トラッキング(追跡)可能なものは何でも、実際にトラッキングされるだろう。特にVRがそうだ。VRは、そもそもの仕組みにより、すべての動き、行動、振る舞い、顔の表情にいたるまで、アバターに投影するために捕捉されている。つまり、VRは最も監視状態にある、ということだ。あなたは最も監視下におかれているのだ。VR企業は我々についての膨大なデータを収集することになる。現実の生活では収集がとても難しいデータを、VRの中ではとても手軽に収集できる。向こう10年から15年で、こういうVR企業が、世界最大手の企業になっていくだろう。

VRとインタラクションの次に取り上げたい2つ目のトレンドは、物事をよりスマートにし、知性を加えていく動き、私が「認知化(コグニファイ)」と呼んでいるものだ。

こういったものはすでにあり、アイフォーンの(音声認識ソフト)「Siri(シリ)」やグーグルナウなどがそうだ。これらが50年前にあったとしたら、「これは人工知能(AI)だ」と認められただろう。だが、今はこれらをAIとは呼ばない。AIとは、我々にできないことをやるものだからだ。人間が達成可能な何かを行うものに対しては、機械学習(マシンラーニング)やエキスパートシステムと呼んでいる。AIは、人間ができないことをやる、と定義されている。

ところが実際には、AIは舞台裏や奥の間で、すでに稼働している。X線画像を人間の医者よりも正確に診断したり、法律文書を弁護士よりも効率よく読み解いたり、飛行機の運航の大半はAIが制御しており、離着陸の7分ぐらいしか人間の介入はない。車のタイヤにチップを搭載することで、人間よりもうまくブレーキをかけることもできる。

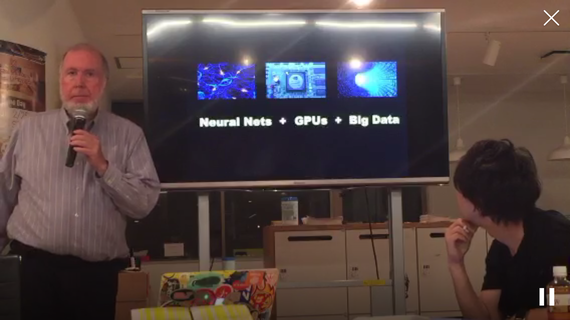

AIは20年、30年前ぐらいからあるものだが、あまり普及はしなかった。ところが今や急速な進化を遂げている。3つのテクノロジーがこの3年ぐらいで登場したことがきっかけになっている。この3つのテクノロジーが収斂することで、パーフェクトストーム(最強のインパクト)を生み出した。1つ目は50年前からあるニューラルネットの(深層学習<ディープラーニング>による)進歩。そして、何百万ドルもするスーパーコンピューターをつくらなくても、AIをパソコンやゲーム機などで使われる廉価な画像処理用プロセッサ(GPU)で走らせることができることを発見した。3つ目は、これまではAIのトレーニングに使うのは数千のサンプルだったが、その代わりに数百万というオーダーのビッグデータを使うようになった。そのため、AI企業の大手のほとんどは、ビッグデータを持っている会社、つまりグーグルやマイクロソフト、バイドゥといったところだ。

この数年でこの3つのテクノロジーが一体となり、AIは急速に進化が可能になった。その結果、数カ月前、(グーグルのアルファ碁が)世界一の囲碁のチャンピオンを打ち負かすことになった。

今やAIは、写真を見るだけで、英語で、お望みなら日本語でも、その写真に何が写っているのかを説明することもできるまでに進化した。あなたがテレビゲームをやるなら、将来的にしばしばAIを相手に対戦することになるだろう。最近、グーグルはAIに対し、ゲームのやり方だけでなく、ゲームのやり方を学習させる方法を学ばせた。これは極めて深い、重要なステップだ。

これら、現在のAIの例は、人工知能(AI)と呼ぶよりも人工知性(アーティフィシャル・スマートネス)と呼んだ方が適切かもしれない。というのも知能(インテリジェンス)という言葉には、あまりに多くの既成概念の制約があるからだ。

電卓はすでに人間よりも優れているし、GPSも人間よりナビには優れている。グーグルも、完全記憶能力(トータル・リコール)に関しては人間より優れている。これら知能のポイントは、人間らしくない、ということだ。AIを自動車に搭載する時には、人間と同じような感覚で運転して欲しくはない。AIが自意識をもって気が散っては困る。AIを広告する時にも、自意識がない、ということを宣伝している。それがメリットだからだ。

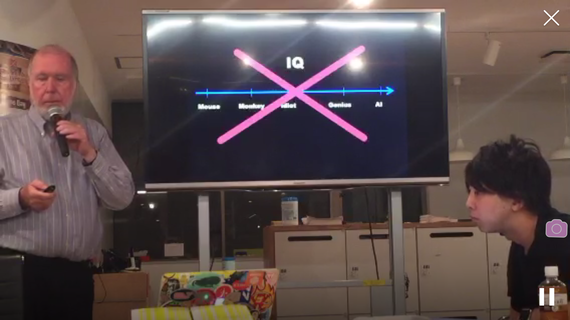

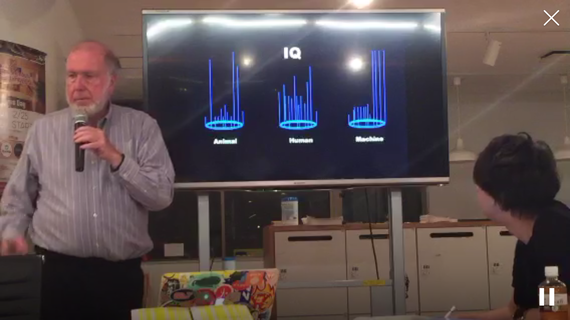

重要なのは、人間は自らの知能についてもあまりよくわかっていない、ということだ。IQというと、1次元の直線的に進化していくものと考えがちだ。音におけるデシベルの目盛りに従い、どんどん音量が上がっていくように。マウス、チンパンジー、頭の悪い人、普通の人、頭のいい人(そしてAI)、といった具合だ。だが、これは全くの間違いなのだ。IQはそれぞれ違った音の響きによるシンフォニーのようなもの。それぞれ違う認知機能が奏でる。そのサウンドは、人によってまちまちのものだ。動物は、ある機能については人間より優れているかもしれないが、他の機能はずっと地味で、それらを統合したものは、人間とは違った思考かもしれない。

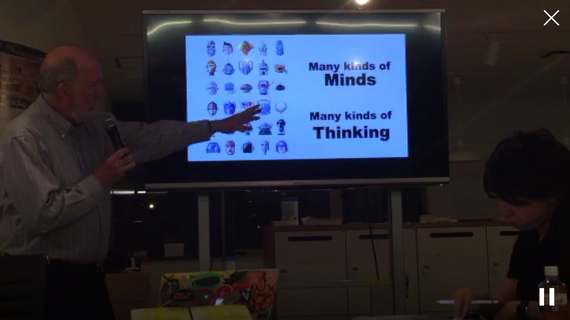

これらはみな、違ったタイプの思考だ。感情的な知能、演繹的な論理づけ、論理的な推測、空間的な推測など私たちの思考の中には、何十もの異なる思考の形態がある。そして、マシンの知能、AIをつくる際には、やはりそれらを設計するわけだ。ある特定の音の響き、特定の思考が突出する一方で、別の領域についてはゼロだったり、きわめて微弱だったりする。それら違ったタイプの思考形態を重ね合わせていくのだ。でも、ある側面では、それが人間より優れているというわけだ。

AIでやろうとしているのは、実際には、数多くの違った種、数多くの違ったタイプの知性、数多くの違った種別の思考をキュレーション(組み合わせ)することで、数百、数千のバラエティに富んだAIをつくろうとしているのだ。そのどれ一つとして、人間のようではない。それらはすべて人間とは違った思考だ。それらはすべてエイリアン・インテリジェンス(未知の知能)なのだ。あるいは人工(アーティフィシャル)エイリアンと呼んでもいいかもしれない。違った思考形態(シンキング・ディファレント)なのだから。

"シンク・ディファレント(※1997年のアップルのキャンペーン)"は、ニューエコノミーのすべての富の原動力だ。AIは、人間が"シンク・ディファレント"になる手助けをしてくれるだろう。

AIの2番目に実現するものは、第2の産業革命を生み出すことだ。

第1の産業革命が実現したのは、私が呼ぶところの"人工動力(アーティフィシャル・パワー)"の発明による。農耕社会では生産は人の筋肉、動物の筋肉を使ったものだった。人間の筋力は4分の1馬力で、極めて限られたものだ。だがその後、化石燃料や蒸気、電気を使うことで、自動車を運転することが可能になった。そこに搭載された動力は、一気に250馬力となった。

この信じられないような"人工動力"を使って、高層ビルや高速道路、鉄道をつくり、工場からは椅子や冷蔵庫がつくり出されていった。我々の暮らしで身の回りにあるものはすべて、"人工動力"によって可能になったのだ。それが第1次産業革命だ。

この"人工動力"を、送電線をつくり、すべての家庭、農場、工場に届けるようになった。それにより、"人工動力"は日用品(コモディティ)、公共サービス(ユーティリティ)となり、極めて安価に購入できるようになった。そして、"人工動力"のコモディティ化は、イノベーションの富の源泉となった。農夫は、それまで手作業でやっていたことに、ポンプを使えるようになった。"人工動力"を加えることで、電気製品が使えるようになった。それにより、生産性は10倍、100倍、1000倍に増幅された。それが産業革命だ。

そして今、その電動ポンプにAI、人工知能を加えようとしている。それにより、スマートポンプが実現する。かつては電化したが、今は認知化(コグニファイ)するのだ。

自動車には250馬力のエンジンを積んだが、今は、250の知性を搭載するのだ。それが自動運転車だ。かつては人工動力、今は人工知能。それによって、自動運転車が実現する。

重要なのは、このAIは"サービス化"し、コモディティとなり、クラウドを通じて、まるで誰でも購入できる電力のように、公共サービスとして流れてくるようになるということだ。コンセントにさせば、必要な分だけ、AIを購入することができる。

つまり、今後立ち上がる1万社のベンチャー企業の方程式は極めてシンプルだ、ということだ。X+AI、Xは何でも構わない、そこにAIを加えるだけだ。例えば、Xにタクシーを当てはめ、AIを加えると、(タクシーのクラウドソーシング・ベンチャー)ウーバーだ。

たった今、いまこの時、でも、それは可能だ。グーグルにログオンし、例えばそのAIを購入することができる。「ボールの色は何」「スカートの色は何」と聞くと答えてくれる。100ヒットで6セントで買える。

AIを体に取り付ければ、ロボットだ。テスラの工場(プレゼン画像)では、製造ロボットはケージに覆われている。人間が誤って近づくと、殺傷の危険があるからだ。だが今や、(学習型産業用ロボット「バクスター」のプレゼン画像)このようなロボットも出てきた。(手書きのような)目があり、回りに人がいるかどうかを確認している。センサーも備えていて、人間を傷つけないようになっている。最も重要なのは、ロボットに作業の仕方をやって見せると、それを見ながら学習していくという点だ。しかも、試行錯誤を行って、自分でそれを改善していくことができる。

このロボットは教える必要すらなく、人間の作業を見ながら覚えるので、人間の隣で、一緒になって仕事ができる。

(1997年に)IBMのAI「ディープブルー」がチェスの世界チャンピオン、ゲイリー・カスパロフを破った。この時、カスパロフは、AIと同じデータベースが自分にもあれば、勝てたかも知れない、と考えた。そこでカスパロフは、AIと闘うのではなく、AIとともにプレーする、新たなチェスリーグをつくった。AIと一緒にプレーするスタイルをカスパロフは「ケンタウロス」と呼んでいる。現在、世界でもっとも強いチェスプレーヤーはAIでも人間でもなく、AIと人間のチーム「ケンタウロス」だ。今後は、人間がコンピューターと協働する、ということが重要になる。

未来は、AIやロボットといかにうまく協働できるか、ということで給料が決まってくるだろう。つまり、対立するのではなく、一緒になる、ということだ。

まとめとして、今後の方向性について説明しよう。

未来はしばしば、信じられない、不可能なものだと思いがちだ。私はかねてから、コンピューターはどんどん小型化し、靴にも椅子にも鍋にもドアノブにも入れられる、と言ってきた。人々は、コンピューターをドアに入れるなんて、バカげている、と考えた。だが、今ホテルに泊まると、ドアノブ(のカードキー)にはコンピューターがちゃんとついている。

だから、不可能なことを可能だと信じてみる、そのような能力を身につけていく必要がある、と思う。我々は、今後20年、30年の間に起きる驚くべき出来事のほんの始まりのところにいる。30年後から今を振り返ってみると、AIの専門家と呼べるような人はいなかったな、と思うだろう。(この領域には)たくさんの資金が投じられ、非常に優れた人々が活動しているが、(30年後の基準では)AIやVRの専門家と呼べる人々はいないだろう。そして、20年、40年先の人々が振り返った時、とてもうらやましがり、「2016年に生きていたら」と思うだろう。なぜなら、とても多くのチャンスがあり、ただ、Xを取り上げて、AIを加えれば、それだけでいいのだから。

今から25年後を席巻しているようなテクノロジーは、今はまだ発明されていない。

つまり、今からでも決して遅くはないのだ。

●落合陽一さんプレゼンテーション

僕は普段メディアアーティストをしていて、あとは(筑波)大学で教員をしているんですけど。僕の専門はメディア学。どういう風に世の中のメディアが変わってきたかを、大学生に教えていて、自分自身はコンピューターサイエンスのリサーチャーです。

僕が今持っているアーディストステートメントは、我々は有史以来、イメージと物質の間をどうやって埋めるかっていうことのために、テクノロジーを発達させてきたのではないか、ということ。それが僕が持っている一番大きなアーティストとしての思いです。

農耕民族だったら、昨日あったことを壁に描くが、それと目の前の現実とはだいぶ乖離がある。それをどうやって埋めるか。描いた麦の分だけ収穫するには、どんなテクノロジーが必要かということをずっと考え続けてきたんじゃないか。

1902年に「月世界旅行」という映像が撮られますけれど、大砲の中に人間を入れて月に持っていくという話です。それが現実に実装(月面着陸)されたのは、それから60年ぐらい先です。そんな風に、最初に人間は思い浮かんで、それをメディア装置としてつくって、その後、それを行動する、ということをしてきたんだと思う。

僕が今、メディア装置をつくる作家として興味があるのは、どうやって物質のような映像をつくるか。例えばこれ(プレゼン資料)は、フェムト秒レーザーという、メチャクチャ速いレーザーを使って、空中に直接描く。AR、VRではなくて、物質として実際に光る点や触れる映像を、空中や三次元の自由位置につくるための技術をつくったりしています。

データを直接空間に取り出し、触覚がある空中映像とか、触覚があるプラズマみたいなものをつくることで、イメージと物質の境界線は徐々になくなっていく。物質と物質じゃないものを同時につくるようなことが、興味としてやっていることです。

こういう装置をつくって、作品発表していくことを、メディアアートと呼んでいたりします。

13世紀から18世紀に至る時に、人間って、いろんなメディアをつくってきた。例えば、カメラ、望遠鏡、メガネだとか、いろんなものをつくってきて。その中の一番稀有な発明は、たぶん映像装置。我々は20世紀、全員で同じ考えを共有したり、全員で同じものを見たりという、マスメディア的な世界をつくったのは、映像によって、時間と空間を共有できるようになったということが最も大きいだろう。

エジソンが発明したキネトスコープ(映画視聴装置)は、世界初のVRゴーグルだということもできる。そういうものが、コンピューターの文脈に入ってきて、1960年代ならコンピューターグラフィックス(CG)を(CG・VRの父)アイヴァン・サザーランドが描き、その5年後ぐらいにはVRゴーグルをつくる。

これは避けられない変化だ。こういった、ヒューマンインターフェイスで起こってくることを、どうやってまとめていくか、ということを研究しています。

メディアアートという観点では、1960年代にナム・ジュン・パイクという作家、ビデオアーティストがいた。ビデオ彫刻という、ビデオを積み上げることで彫刻をつくった人だ。今でいうと、これはプロジェクションマッピングが多分したかったんだけれど、高解像度のプロジェクターもないし、ブラウン管を積むしかなかった。

そういうことを僕も研究していて、どうやったら質感を表現できるディスプレーをつくれるか、とか。どうやったら、反射分布を変えられるディスプレーをつくれるか、を研究しながら、映像表現をしている。実際にやっていることは、数式を解いて、それをハードウェアにしていくということ。その過程の中で、メディアをつくる、ということは、今の文化へのメディア批評性を持っていて、そこから見える見知を考えていこう、と。

僕が今、向かい合っているのは、(コンピューターが環境に溶け込むという)ユビキタス(遍在)・コンピューティングという考え方をどうやって超えていくか、ということ。これは1991年にパロアルト研究所(のマーク・ワイザーの論文)によって予言されていたが、マルチメディアテクロノジーは、以後24年かけて非常に成熟してきた。この次にどうやっていくか、というのはすごく大きな課題。

その中で僕が面白いな、と思っているのは、今、メディア装置は、人間の目とか耳で規定される。それをどうやって、超えていくか。そのキーワードは、強度が高くで、解像度が高くて、今二次元にあるものが三次元に結像するようなものとして出てくるはず。そうすると、光を空中に直接描けるようになるし、音の形も、触覚をつくったりとか、知覚的な効果があるような音波の形状を、つくることができるようになってくるはず。それは、今まで我々が持っていた映像メディア、目のための光と、耳のための音、という概念を超えて、僕らに訴えかけてくるはずだ、ということを考えている。

これ(プレゼン映像)は音波によって、浮いたり構造化したりしているものです。僕の専門は、メディア装置として、光や音を形づくっていくということ。人とコンピューター、音波や電波や光が、将来は生態系をつくっていくだろう、ということを考えている。

僕はそれを、数理的にモデリングして、実際にどういう形が人に届くのか、どういう形を出せば、人はそれをディスプレーとして見るのか、を研究している。

それは例えば、光でつくるホログラムだったり、超音波でつくるホログラムだったり。やがてそれが、人間を含めて、デジタルネイチャーという生態系を、大きくつくっていくんだろうな、と思っています。

デジタルネイチャーの基本的な考え方は、マテリアルとして存在する物質と、バーチャルの実質の間に、複数の選択肢を持つということ。お嫁さんがVRゴーグルの中にいてもいいと思っている人もいるし、逆に物質じゃないと、と思っている人もいる。そのうち、半分ロボットで半分VRみたいな、そういうセクサロイドのようなものが出てくるかもしれない。

そういう仮説をつくっていくことを、うちの研究室は研究している。物質と実質、ヒトと機械の間にどういう可能性があるんだろう。それを実際につくっていく、ということをしています。そこにたくさんの選択肢とストーリーがある。

僕はリアルメディアが専門だけど、うちの学生だと、今ある木とか木目は、ライトフィールド・ディスプレイだったら、木だけどディスプレイ、鏡なんだけどディスプレイというものがつくれないか、と。マテリアルのプロパティを保ちながら、違う形のディスプレイをつくることができるんじゃないか、とか。今のタブレットはガラスで出来ているが、すごく柔らかくて心臓みたいに波打つタブレットだったら、とか。人間は今は対象物を認識して体を動かしているけれど、視覚的な刺激を与えることで、人間はどうやってマニピュレ-ション(操作)可能なのか、とか。

僕は光、音が専門だが、それを人間と物質のかかわりにおいて、どうやって人は操作されるか、という研究も。これ(プレゼン資料)は音の制御。空間のここだけド、ここだけミ、ここだけソの音が聞こえるコンサートホールを用意してあって、そこに人を配置すると、練習なしに、耳にかかってくる音をまねするだけで、合唱ができる。今まで、我々はコンピューターを演奏の道具に使っていたけれど、人間がコンピューターに演奏される未来が、あってもいい。それは割と簡単に制御可能なはずです。

人と体とカメラ認識とAIと絡めながら、あり得るシチュエーションをどんどんつくっていく。やがて、パペットの中にはロボットが入るはずだけど、そこに人工知能が載るか、遠隔の人間が載るかは、まだどちらの選択肢もあり得る。訓練されたアクターの方がうまいかもしれない。だけど、確実にロボットにはなると思うから、ロボットとアクターをつなぐところを研究しよう、とか。

僕は、アクチュエーション(可動化)されたエンバイアロンメント(環境)とか、ロボット化された、コグニファイ(認知化)されたあらゆるものを、どう考えて行くかということに、時間を使っています。それは3Dプリンターで設計してもいいし、ロボットをつくっても、空中ディスプレイをつくってもいい。将来、物質として存在するもの以上の価値、あらゆる選択肢が、いろんなところに出てくるはず。それを予見させるために、色々な形状を、視覚とか聴覚の面で、つくっていってやろう、と考えている。

なぜそんなことを考えているかというと、昔は、クラフトマンがパーソナライズされたものをつくっていたけれど、映像の時代は、デザインしてみんなで同じものを使うのが基本だった。21世紀になったら、個々のテクノロジーは、個別にできてきて、生態系のニッチを埋めるように、全然違うテクノロジーが同時に存在してもよくて。それをどうやって研究していけるのか、ということを考えている。

選択肢をいっぱいつくりながら、選択肢自体が、音楽の領域とか、エンターテインメントの領域とか、いろんな領域の中に、バーチャルでも物質でもないものを、埋めていくことで、人間にとって自然な、コンピューターと人の関わりを考えて行こう、ということを、やっています。

●ディスカッション(司会:服部桂さん)

落合氏:テクノフォビア(テクノロジー恐怖症)、テクノロジーを受け入れられない人と、どうやって会話していくのか。テクノロジーというものの価値を説得していくのか、ということは、我々デジタルコミュニティが持っている最大の問題だと思うんですが。これまで、多数のテクノフォビアと出会ってきたと思うんですが。

ケリー氏:私は、それが決して得意とは言えない。私自身、テクノロジーに対して度が過ぎたオプティミズムがあるからだ。

私のテクノオプティミズムは、歴史に由来する。過去200年を振り返って見ると、毎年のように人間は進歩してきた。テクノロジーを怖がるテクノペシミスト(テクノロジー悲観主義者)については、彼らは間違っていない、とも言える。数多くの問題があることは、確かだ。テクノロジーの進化によって、次から次へと多くの新たな問題が持ち上がる。テクノロジーが強力になれば、それを強力に悪用することもできるからだ。だから、テクノロジーの到来によって、多くの恐ろしい問題が出てくるというペシミストの指摘は、その通りだと思う。我々が今直面している問題は、過去のテクノロジーによって引き起こされてきたものだ。今後20年のうちに起きる問題は、今まさに発明されているテクノロジーによって引き起こされるだろう。

これらの問題に対するソリューションは、テクノロジーを抑制することではない。より多くの優れたテクノロジーを生み出すことだ。もし私がバカげたアイディアが言い出したとすると、あなたの反応は「バカなこと言うな」ではなく、「もっといいアイディアを出せよ」が正しい。バカげた有害なテクノロジーに対する正しい反応は、テクノロジーの抑制ではなく、より多くの優れたテクノロジーだ。それがテクノペシミストに対するメッセージだ。

落合氏:こういう時、日本では、では原発はどうするんだ、と言われる。原発については、解決出来ない問題としてテクノフォビアが絶対に挙げてくる。でも僕は、2040年ぐらいには、太陽電池の発電効率はもう20%ぐらい上がっていると思うので、50年、60年後には解決すると思う。いずれ時間で問題は解決するはずだが、(テクノロジーへの不信感で)出ばなをくじかないで欲しいな、と思いながらテクノフォビアとは向かい合ってます。

服部氏:よりよいテクノロジーで問題を乗り越えるのは、そう簡単ではないような気もするが。

落合氏:インターネットができてから、サポートテクノロジーがやさしくなったと思う。昔は、新しいテクノロジーが出てくるときは、特権的な存在だった。だが、ソフトウェアコミュニティは、むしろチュートリアル(解説文書)を丁寧につくったりとか、コードを全部(共有サイトの)「Github(ギットハブ)」で共有したりとか。リナックスの文化が生きていると思うんですけど。そういうことによって、テクノロジーが自分の牙城をつくることをよしとしない文化が広がって、それがすごくいいと思う。

服部氏:ケリー氏も元々は、テクノロジーは権力とか企業の金もうけのためと思い、コンピューターも悪者だと思っていたが、電話・インターネットにつないだら、違った、と。

ケリー氏:ヒッピー時代、テクノロジーは冷たく、硬く、巨大な、遠ざけておきたいものだった。私自身は持ち物も家も、すべてをシンプルに過ごしていた。ところが、コンピューターを電話線につないだ途端、テクノロジーの全く違う側面を垣間見た。それは、より人間的で、柔軟で流動性があり、人の暮らしのようだった。それによって、テクノロジーに対する認識が変わった。

落合氏:この本(ケリー氏の新著)を読んでいて、未来に対する仮説を立てることが、能力としてすごく重要だな、と。人工知能ついても、何の問題でも答えてくれる人工知能、我々と違う考え方をする人工知能など、たくさんの例が紹介されている。そのような仮説を、ストーリーテリングする能力が、10年先を考えるとすごく重要だと思う。ストーリーをつくると、よい面、悪い面、なさそうなこと、ありそうなことが交差していく。普段からそのようなストーリーづくり、仮説づくりは考えているんでしょうか。それが、今、世の中のビジネスマンには足りないものだと思っている。それが、ビジョナリーと他の人々を分けるポイントだと思うんですが。

ケリー氏:訓練というより習慣だが、疑問を投げかけるということが、人間にとって、基本的で、最も有益な行動だと思う。答えが欲しいだけなら、機械に聞けばいい。人間に価値があるのは、「もしこうなら(What if)」「これはどうだ(How about)」「どうして(How come)」「こうしたらどうなる(What happens by doing this)」「あっちならどうだ(What about that)」。イノベーション、探査、科学、創造性、すべて疑問を投げかけることに足場がある。我々の仕事は、どんどんとその上に展開していく。不確実性と疑問。それこそが我々人間にとっての根本的な仕事だ。

落合氏:(ケリー氏の)本の中で、実現可能性があって、望ましい未来を描いたSF小説を読んだことがあるか、という話が出てくる。多分、望ましい未来を与えるSF小説って、話としてあんまり面白くないから、買ってくれなかったんだろうな、と。そのおかげでテクノフォビアが育って、社会に悪影響を与えているんじゃないか、と思うんですが。望ましい未来を与えるSF小説でも面白いって、どういうジャンルなんだろうか、と。

服部氏:どうやって、未来像を共有するかということだと思うんですが。

ケリー氏:SF映画はとてもディストピアのものが多い。我々が住みたいと思うような地球の未来を描いたハリウッドのSF映画など1本もないんじゃないか。「スタートレック」? あれは地球の話じゃないし。今後は、望ましい未来を描く作品があると、我々の考え方にもいい影響を与えてくれると思う。

未来についての一つの考え方は、誰もが当たり前に想定していることに、疑問を投げかけることだ。みんなの想定は、大概の場合正しい。だが、時に間違うこともあり、それがインサイト(洞察)やストーリーのきっかけになる。例えば、(半導体チップの集積度は2年で2倍になるという)「ムーアの法則」が停止してしまったら、どうなるか。誰もが続くものと思っているが、もし止まったら、すべての物事を変えてしまう。私が描いたほとんどの未来は起きなくなってしまう。一方で、もし逆に「ムーアの法則」が加速したらどうなるか? 例えば20倍に。それは驚くべき未来になる。つまり、毎年性能が上がるだけでなく、毎年何倍も性能が向上することになる。そのようにストーリーを考えることができる。ストーリーを考えて行くとき、例えば「ムーアの法則」が止まってきている、という研究論文を探す。そのストーリーをリアルなものするために、どんなエビデンスが他にあるか、を調べて予測をまとめあげていく。また逆に、「ムーアの法則」が2倍に加速しているというエビデンスがないかどうかも調べる。このプロセスの半分は着想、残り半分はその実現になる。現実とバーチャルを融合させたい、ということなら、どういうやり方があるのか、どういうエビデンスがあるのか、を調べていくということだ。

服部氏:今、AIとの組み合わせで、最もあり得ない想定とは?

ケリー氏:本の中で、AIとのあり得ない組み合わせのリストをまとめておいたが、その最後のあり得ない組み合わせがAIと編み物だった。だが昨日、ドイツの人からメールをもらって、彼らは編み物用のAIプログラムを開発した、というのだ。つまり、すでに実現してしまった。何かに知性を加え、より賢くしていくということが起きないものはない、と思う。もう何が起きても驚かないが、驚べきなのは、その副次的な効果だ。SF作家のアーサー・C・クラークは、自動化そのものについては、誰もがたやすく想像できる。馬車が自動車になる。Xプラス自動化だ。本当のインパクトは、自動車の到来によって引き起こされた副次効果だ。交通渋滞、ラッシュアワー、ドライブイン映画館、それらは副次効果で、予測することは極めて難しい。X+AIは想像しやすいが、その副次効果となると、想像するのは難しい。副次効果をイメージするトレーニングとしては、自動車がユビキタス(遍在する)なものになったとき、何が起きるかを考えることだ。それが交通渋滞やラッシュアワーにつながる。AIがユビキタスになり、誰もが使うようになったとき、何が起きるか。そこがストーリーが本当に面白くなってくるところだ。まったAIを持たない人、アーミッシュのようにAIを持つことを拒否する人々も出てくるだろう。AI同士がコミュニケーションをするよになったら、全く違う世界が生まれるだろう。

会場からの質問(私):30年後のニュースはどんなものになっているでしょうか?

ケリー氏:ニュースの方向性としては、直線的なテキストを中心としたもの、ページに掲載されたテキストから、動画へと移行していくだろう。テキストも残るだろうが、動画との組み合わせとなり、文化の中心、ニュースの中心は動画になっていくと思う。ただ、動画をどのようなものにしていくべきか、についての議論はまだ始まったばかりだ。VRにしろ、テキストとの組み合わせにしろ。いずれにしても、動画についての考え方は、まだ全く完成されたものではない。だが30年後は、メディアニュースは大部分が動画に移り変わっているだろう。テキストは、極めて圧縮されているので、動画視聴よりも速く読むことができる。この情報圧縮は非常に便利ではある。なので、動画の中にテキスト加えていくことも選択肢だ。これはいずれか一つという選択ではない。動画が主で、テキストはその一部になるのかもしれない。

落合氏:フランスのトラックテロのニュースでは、テキストメディアよりも、(動画共有アプリ)スナップチャットで撮られた動画の方をよく見た。テキストメディアは三人称形で、あったことを三人称で書くというもの。一人称形もしくは二人称形、人がスマホでその場で撮った動画を、いくつもユーチューブに上がっているのを数珠つなぎに見ていくと、体験としては、とても主観的な体験になる。(動画で)追体験していくと、「死者80人」という数で表現されているものとは全然違う印象を受ける。ニュースの形って、(動画の場合)想像力が直接やってくる世界だなと思う。

会場からの質問:経験が通貨、という話をされた。バーチャルテクノロジーが発達すると、私たちが貧困国に行って、その生活を想像する、体験する、難民キャンプで難民がどんな苦労をしているかを体験する。それをVRで体験することで、世界はよりよい方向にいくのか? いや、そんなものは見たくない、という人が多くて、世界はそれほど変わらないのか?

ケリー氏:VRだけでなく、現地に行き、自動翻訳を通して人々とコミュニケーションをとり、理解することもできる。それらのテクノロジーは協力と協働を促すだろう。文明とは人類の誕生以来、協働の拡大によって成り立ってきた。人間が手を携えることで、狩猟、農耕、街をつくった。科学も協働の取り組みだ。この新たなテクノロジーによって、他の人々への共感を強め、それが現地に足を運ぶことにつながり、コミュニケーションを進めていく。それにより、よりよい人間になっていけると思う。数千年前よりも、人はよりよくなっていると思う。従って世界はよくなる。

(2016年7月24日「新聞紙学的」より転載)